skug entwickelt dank Projektförderung durch den Innovationsprozess von Faktor D, dem strategischen Netzwerk für Demokratie im DACH-Raum, und der Wirtschaftsagentur Wien gemeinsam mit KI-Expert*innen und Spielentwickler*innen aus der Schweiz ein digitales Spiel zum Parlamentarismus, das auf künstlicher Intelligenz basiert. Okay, okay, an dem Satz ist jetzt wirklich einiges zu erläutern. Das tun wir in einer kleinen Artikelreihe, in der wir unsere Kooperationspartner*innen vorstellen, das Spiel »Kollektive Intelligenz« (ganz richtig gelesen: »kollektiv« und nicht »künstlich«, dazu mehr im dritten Teil der Serie) präsentieren und die Hintergründe für die Entwicklung beleuchten.

Intelligenz vs. Illusion von Intelligenz

Zwei allgemeine, brennende Fragen sind mit dem Projekt verbunden. Erstens, die Demokratie könnte langsam zum Auslaufmodell werden, und zweitens, der Einsatz von künstlicher Intelligenz verändert die öffentliche Debatte. Diese Technologie könnte das Potenzial haben, unser aller Leben tiefgreifend zu verändern. Kurioserweise lässt sich nicht einmal sagen, ob sie dies wegen der in ihr liegenden Möglichkeiten tut oder weil eine Mehrheit (oder sehr mächtige Minderheit) glaubt, dass sie dies tun kann. Die aktuellen Gefahren sollten hierbei immer wieder vor Augen geführt werden: Manipulation, Betrug und Diebstahl geistigen Eigentums dürfen nicht einfach unter »Innovation« subsummiert werden. Die Large Language Models (LLM) können nichts »verstehen« und sind von Intelligenz genau so weit entfernt wie ein Tamagotchi (Erinnert sich noch wer? Sonst bitte googeln!), aber den neuen KI-Programmen kann besser als je zuvor Intelligenz unterstellt werden, weil es sich eben ein bisschen so anfühlt.

Um diese komplizierte Gemengelage zu durchblicken, können wir es uns in diesem ersten Beitrag unserer Serie zur »Kollektiven Intelligenz« nicht ersparen, Begriffe wie Muster, Mustererkennung, Maschinenlernen und dergleichen einmal unter die Lupe zu nehmen. Ja, das ist durchaus kompliziert. Es muss aber einmal angesprochen werden, um sinnvoll und kritisch über KI reden zu können, sonst wiederholt man nur den manipulativen Slop, den die KI-Akteur*innen gerade ins Netz gießen. Denn Vorsicht, die folgen alle streng ihren eigenen Interessen. skug nicht, wir haben dankenswerterweise tolle Projektförderungen, von denen Sam Altman zweimal lecker in Manhattan essen geht (inklusive Hubschraubertransfer), und sind als unabhängiges Magazin vorbehaltlos an Aufklärung interessiert. Okay, das stimmt nicht hundertprozentig, denn wir hoffen zugleich, dass uns die KI nicht auffrisst und Kulturmagazine wie dieses bald vollkommen verunmöglicht. Zugegeben, in jeder Suche nach Erkenntnis liegt ein wenig (Eigen-)Interesse, aber das ist bei skug fraglos eine andere Liga als bei OpenAI, Google, Meta, X & Co. Die suchen strikt nach Strategien, die Öffentlichkeit im Sinner ihre horrenden KI-Investments zu manipulieren. Mal mit burschikoser Begeisterung (»It’s more profound than fire« – Sundar Pichai, Google), mal mit ominösen Untergangsfantasien (»Risk of extinction« – Bill Gates, Microsoft). Gegen Hypes hilft nur Wissen. Also, los geht’s.

Besser vorhersagen ist nicht verstehen

Künstliche Intelligenz oder eben Artificial Intelligence beschäftigt skug bereits seit Jahren Wie sollte es anders sein? Zu dem Thema hatten wir bereits 2023 ein Panel beim Salon skug. In den letzten zwei Jahren hat sich viel getan, Trump wurde (wieder) Präsident und versprach, hunderte Milliarden in das Projekt zu stecken. So ziemlich alle Länder der Welt (außer dem Vatikan?) tun es den USA gleich. Das ist zwar politisch wichtig und intellektuell faszinierend, aber im Kern hat sich in den letzten Jahren nichts geändert. Die Grundüberlegung der künstlichen Intelligenz ist und bleibt philosophisch gesehen Unsinn: Die Maschinen »erkennen« zwar Muster, diese müssen aber zunächst durch Abstraktionen herausgefiltert werden. Was immer Menschen im Leben tun, die schlausten und die dümmsten, folgt ursprünglich keinem Muster, es kann nur nachträglich als solches beschrieben werden. Heißt das, dass wir als Menschen frei sind und unendliche Möglichkeiten haben? Ähhhmm, nicht notwendigerweise. Sehr alte Debatte, endet übrigens unentschieden und ist ein anderes Thema.

Nur so viel: Als Menschen werden wir niemals wissen, ob wir unendliche Möglichkeiten gehabt hätten, weil wir als endliche Wesen nur das tun können, was in unser kurzes Leben passt. Niemand soll sich deshalb jetzt unendlich viel auf die eigene Kreativität einbilden, denn die ist individuell ganz sicher begrenzt. Wir sind alle einzigartig, aber noch lange nichts Besonderes. Deswegen setzen wir beim Tennisspiel oder beim Dichten jeweils immer nur eine begrenzte Anzahl von Kniffen ein. Bei Johann Wolfgang von Goethe oder Roger Federer sind es eben mehr als bei Normalos und manches, was die Champs tun, ist originell und ohne Vorbild, aber ihre Möglichkeiten sind zugleich sicherlich nicht unendlich. Nur dennoch – und das ist das Entscheidende – ist uns ein Leben geschenkt, in dem wir, aus unserer beschränkten Sicht auf das Ganze, potenziell unendlich kreativ sein könnten. Wir wurden nicht in ein Muster geboren. Die Maschinen haben zu diesem Leben keinen Zugang, weil sie selbst nicht leben, und können nur das Muster-Filtrat kopieren.

Das Hirn, ein Haufen Muster?

Einer der Väter der künstlichen Intelligenz ist der US-Psychologe und Informatiker Frank Rosenblatt. Sein »Genie« lag darin, die transzendentalen Schemata zu verkennen, die für das menschliche Erkennen notwendig sind, und stattdessen das menschliche Hirn auf eine Sammlung von Mustern zu reduzieren. Die dabei auftauchenden Widersprüche fielen ihm nie auf und werden bis heute von der KI geleugnet. In der Kurzversion: Ein kleines Kind hat keinerlei Probleme damit, einen Hund als Hund zu erkennen, während die KI mit Millionen Aufnahmen von Hunden aus allen Blickwinkeln nicht sicher sein kann, einen Hund vor sich zu haben. Diese Millionen Hundebilder hat das Kind aber nie gesehen … musste es auch nicht, weil es dank der Erwerbung seiner transzendentalen Schemata den Hund »an sich« wiedererkennen konnte. Rosenblatt baute mit seinem genialen Irrtum eine der ersten Maschinen, die selbstständig »lernen« konnte, allerdings nur vor dem Hintergrund, dass er selbst immer wieder eingreifen musste. Nach einer Weile formierten sich aber statistische Pfade im Apparat, die zu dem gewünschten Ergebnis führten. Die Maschinen konnten zwischen Kreis und Quadrat »unterscheiden«, sprich, sie wurden mit der Zeit besser darin, die einzelnen berechenbaren Eigenschaften den geometrischen Formen zuzuordnen. Das ist fraglos erstaunlich, belegt aber letztlich nur, wie zuverlässig Abstraktionen eben sein können. Die Maschinen erkennen nicht, sie speichern letztlich das Erkennen der Menschen und imitieren dies später.

Genau deshalb mussten wir braven User*innen jahrelang online mittels Captcha unsere Menschlichkeit (»Ich bin kein Roboter«) unter Beweis stellen, indem wir beispielsweise in einer Kollage aus Fotos den Teil anklicken, in dem eine Ampel oder ein Motorrad zu sehen war. Woher soll der Kollege Computer, der nur aus Nullen und Einsen besteht, auch wissen, was eine Ampel ist? Nachdem er aber millionenfach von Menschen Ampeln angeklickt bekam und somit von ihnen hatte erkennen lassen, wurde er ziemlich gut darin, hochzurechnen, ob ein Ding eine Ampel ist oder nicht. (Übrigens nur »ziemlich«, deshalb sind selbstfahrende Autos in Städten eine tödliche Gefahr und sollten für immer verboten bleiben.) Ein anderes, früheres Beispiel war das Erkennen von Postleitzahlen auf Briefen. Nachdem man Millionen an Briefen mit den kuriosesten Handschriften gescannt und maschinenlesbaren Ziffern zugeordnet hatte, wurden die Maschinen immer besser darin, dies selbst zu »erlernen«. Wenn sie doch einen Fehler machten, konnten Menschen diesen ausbügeln und trainierten mit diesen Feedback-Loops das System. Das System funktionierte irgendwann so gut, dass die Menschen aufhörten, Briefe zu schreiben. Oder lag das am Aufkommen von E-Mail? Eines von beiden.

Das ist keine Sprache, die tut nur so

Dann wäre da dieser allgemeine Irrtum der KI-Proponent*innen im Hinblick auf das Wesen der Sprache. Die KI-Hausierer*innen setzen sprachlichen Ausdruck mit Denken gleich. Das ist zunächst mal fies gegenüber Aphasiker*innen, denn die können sehr wohl denken, aber aufgrund eines Gehirnschlags (z. B.) nicht mehr sprechen. Die Formulierung ist beim Denken niemals ursächlich. Um es einmal persönlich und pathetisch auszudrücken: Wer bei der Geburt eines Kindes anwesend sein durfte, kann später davon erzählen, welch ungeheure Menge an Gedanken und Gefühlen in diesem einen Moment Körper und Geist erfüllen. Aber das sind keine Texte. Versuche ich mich an die Geburt meiner Kinder zu erinnern, fällt mir kein einziger gescheiter Satz ein, den ich der KI für ihren Auftrag »Beschreibe die Geburt eines Kindes« mitgeben könnte. Es ist geradezu Beleg für die Tiefe einer Erfahrung, dass sie eben nicht zu verbalisieren ist. Für Situationen dieser Art gibt es keinen Prompt.

Anderes Beispiel: Die erste Begegnung mit der »Liebe deines Lebens« ist in vielen Songs mal besser, mal schlechter eingefangen worden. Das Spektrum beginnt zum Beispiel bei »The First Time Ever I Saw Your Face« und versandet irgendwo zwischen DJ Bobo und DJ Ötzi. Nur, das ist alles im Nachhinein aus der Erinnerung produktiv zusammengesetzte Kunst oder eben flutschiges Hirni-Gaga. Aber egal, wie künstlerisch hochwertig dies nachträglich eingefangen wird, es ist niemals der Moment der Erfahrung, denn der ist nicht Muster, der ist nicht Sprache, der ist das Leben selbst, das wir nie ganz verstehen, weil wir es vollziehen. Die KI-Vorstellung, alle Welterfahrung sei sprachliches Muster, ist eine unsinnige Engführung menschlichen Lebens und Erlebens. Das Problem ist hier, wie überall bei KI, dass dieser Unterschied unerheblich wird, wenn genügend viele Menschen glauben, es gäbe diesen Unterschied nicht. Man kann sehr gut in der »Wirklichkeit« einer Täuschung leben.

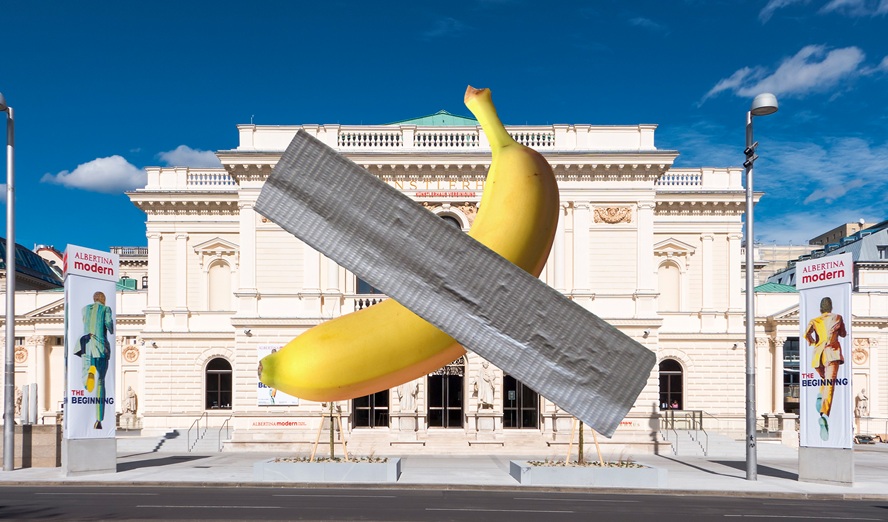

Hiermit wäre auch leicht erklärt, warum alle KI-Kunst so bedeutungslos und ermüdend wirkt. Sie steht in keinem Zusammenhang mehr mit einer echten menschlichen Erfahrung und ist deshalb notwendig vollkommen belanglos. Auch schlechte Künstler*innen können uns etwas über ihre Sichtweise und ihr Erleben der Welt vermitteln, was vielleicht nichts Besonderes sein mag, aber die gewisse Dignität dessen aufweist, dass es eben ein anderes menschliches Wesen so erlebt hat oder zumindest glaubt, so erlebt zu haben. Was die Maschinen sich auf Hochglanz zusammenpolieren, ist hingegen völlig unerheblich und nervt ja auch nach wenigen Beispielen. Es mag »watchable« sein, aber ist nie »re-watchable«. Was sich im Netz hingegen besser hält, sind jene nachträglich von Menschen frisierten und angepassten KI-Erzeugnisse. Diese Täuschungen sind kniffliger zu durchschauen und durch diesen menschlichen Feedback-Loop kann ganz viel von gerade noch erträglichem Zeug produziert werden, das die Kanäle zumüllt.

KI birgt große Möglichkeiten

Jetzt aber mal genug des KI-Bashings, die Technik hat es ja auch in sich und kann klug genutzt werden. Menschliche Entwicklung stand immer vor dem Problem, vor den undurchsichtigen und unüberschaubaren Datenhaufen kapitulieren zu müssen. Riesige Datenmengen die – selbst bei schlauer Arbeitssteilung – nur mit gigantischem Aufwand bewältigt werden können. Verwaltung, Wissenschaft und auch Kunst können heute fraglos davon profitieren, wenn sie Suchassistenten einsetzen dürfen, die schnell Datenberge durchleuchten. Menschen wird langweiliges Herumgesuche erspart, das oftmals so umfangreich ist, dass es in vielen wissenschaftlichen Disziplinen innerhalb einer menschlichen Lebensspanne nicht zu bewältigen wäre. Dank neuer GPUs, die nicht mehr linear, sondern parallel rechnen, können KIs neue Verbindungen finden oder Verknüpfungen herstellen, die sonst wohl nie möglich gewesen wären. Da ein Großteil des menschlichen Wissens bereits digitalisiert ist, herrscht hier eine berechtigte Goldgräberstimmung. Herstellung neuer Materialoberflächen, künstliche Proteine und vieles mehr können die Menschheit einen Riesenschritt nach vorne bringen. Es konnten bereits durch Maschinenlernen, also allein durch Mustererkennung, 200 Millionen neue Proteine ermittelt werden. Die Ergebnisse von Google DeepMind/AlphaFold ermöglichen neue Medikamente, die Menschenleben retten können. Großartig, wenn dies geschieht, aber wird dieses neue Wissen geteilt oder doch eher vermarktet?

Hmmm, einfach mal recherchieren. Und an dieser Stelle dürfen wir uns dann gleich einmal fragen, warum die Suchmaschinen (von denen wir alle längst abhängig geworden sind) in den letzten Jahren immer schlechter geworden sind. Sogleich verfliegt die Protein-Euphorie. Die digitalen Möglichkeiten, Wissen zu teilen, werden zunehmend von kommerziellen Interessen begrenzt. Ironisch gesagt, dürfen wir festhalten, dass das ja auch seine guten Seiten hat. Vor ca. fünfzehn Jahren sah es so aus, als sei der Musikjournalismus vollkommen unsinnig geworden. Man musste damals nur einen einzigen Interpret*innen-Namen bei YouTube eintippen und bekam sogleich einen wunderbaren Werkkatalog sowie eine Liste ähnlicher Künstler*innen präsentiert. Interessierte konnten sich beispielsweise durch die verwinkeltsten Pfade des japanischen Free Jazz führen lassen. Heute schlägt YouTube nur mehr kaputten Unsinn vor. Das meiste zum Thema »Wie man schnell reich wird«. Und deswegen lesen ja jetzt auch alle wieder skug! Will sagen, es zeigt sich, dass das Netz durch die Innovationen der letzten Jahre nicht immer besser, sondern zunehmend auch von kommerziellen Interessen geschädigt wurde. Warum sollte es bei KI anders sein, insbesondere, nachdem Milliardenbeträge investiert werden mussten?

Ich und meine Maschine

Zusammenfassend darf festgehalten werden: Die neuen KI-Technologien mögen existenziell gesehen eine Täuschung sein, weil sie weder menschliche Intelligenz noch Erkennen erreichen, sondern nur Muster abgleichen können; die unüberschaubare Fülle der verbundenen Muster wird aber von Menschen wie ein intelligentes Erkennen interpretiert. Damit erlauben sie eine neue, durchaus vielversprechende Interaktion zwischen Mensch und Maschine, die idealerweise nicht kommerzieller Manipulation dienen sollte. Wir User*innen lehren die Maschine zu »lernen« und können dabei Sprache als Eingabemedium nutzen. Im Prompt beschreiben wir möglichst genau, was wir wollen, und bewerten dann die Ergebnisse. Mit diesem Feedback-Loop trainieren wir den Apparat und zugleich auch uns selbst. Die Designer*innen der Zukunft werden ihre Aufgaben für die KI-Maschine genau formulieren müssen und dann schafft das das LLM schon. Nur sind wir da noch lange nicht. Bei der Arbeit am digitalen Spiel »Kollektive Intelligenz« zeigte sich oftmals, dass es für die menschlichen Expert*innen einfacher war, die Programmierung selbst zu übernehmen. Es wird nämlich auch deutlich, dass die KI oft nichts von dem versteht, wovon wir Menschen sprechen.

Das »In-Context Learning« erlaubt der KI zwar, den Inhalt einer sprachlichen Aussage in Befehlsmuster umzusetzen, kann dabei aber niemals den Inhalt verstehen. Für Menschen fühlt sich dies zuweilen wie ein Dialog mit jemandem an, der unendlich dumm ist, und das ständige Re-Inforcement ermüdet die User*innen. Allerdings fühlt es sich dennoch wie ein Dialog an … Die Unheimlichkeit dieser Situation wurde noch immer nicht genügend herausgearbeitet und ist irgendwie noch nicht ins allgemeine Bewusstsein gesickert, denn es denkt in diesem Prozess der Interaktion mit der KI nur die eine Seite, die menschliche. Sie macht dies so lange und intensiv, bis sie irgendwann das Gefühl hat, die andere Seite würde auch denken. Macht die KI aber eben nicht. You’re alone, baby – completely alone. In aller Deutlichkeit: Wir unterhalten uns beim Chatten mit der Illusion eines Gegenübers. Da ist aber nicht einmal eine sprechende Mumie, sondern lediglich die Musterkombination einer »Person«, die es nicht gibt, nie gegeben hat, nie geben wird. Eine grausamere Täuschung kann man sich eigentlich kaum vorstellen. Könnten wir das Konzept der Large Language Models per Zeitmaschine ins 19. Jahrhundert schicken, dann würde Edgar Allen Poe vermutlich sagen, »Ne, lasst mal gut sein, die Geschichte ist mir viel zu grausam!« Dann lieber im Keller eingemauert werden.

Schöne neue Arbeitswelt

Nur leider steht zu befürchten, dass die neue Arbeitswelt genau diese existenzielle Einsamkeit befördert. Die großen Konzerne und vermutlich auch die Verwaltungen werden alle Mitarbeiter*innen raushauen, die nicht mehr unbedingt gebraucht werden, und am Ende ist da nur mehr eine winzige menschliche Workforce, die sich mit Prompts und deren Verbesserung rumschlägt. Der US-Comedian Gianmarco Soresi hat es gut auf den Punkt gebracht, als er meinte, es gäbe nur einen Job, der vor der KI sicher ist: Jener Typ, der am Times Square mit Silberfarbe im Gesicht so tut, als sei er ein Roboter. Das wäre wirklich zu selbstreferenziell, wenn das die KI auch noch übernehmen würde. Der Rest ist up for grabs. Wohlgemerkt nicht, weil dadurch irgendetwas notwendig besser werden würde, sondern weil es halt billiger ist. Dankeschön, Kapitalismus, auf dich können wir uns verlassen!

So, nachdem nun die Reste unserer Humanität mit den stilistischen Mitteln des Pop-Journalismus erfolgreich verteidigt werden konnten, heißt es im zweiten Teil der Serie festhalten, warum dies alles für die Demokratie entscheidend werden wird. Und ach ja, das Spiel »Kollektive Intelligenz« spielen wir in einer Erprobungsversion am 28. Juni 2025 erstmals im Wiener Museumsquartier beim Speeddating Demokratie im Rahmen des Salon skug. Unbedingt vorbeischauen!